告別無效搜尋,擁抱智慧檢索時代

您的搜尋引擎還在用關鍵字比對,讓顧客找不到商品嗎?這篇文章揭示了傳統搜尋如何扼殺高達40%的轉換率!我們將帶您深入了解 2026 年企業級搜尋的標準答案:在 Laravel 中實戰結合關鍵字與向量的「混合檢索」技術。學習如何透過非同步處理與 RAG 架構,打造一個既懂語意又懂精準匹配的智慧搜尋引擎,將流失的顧客通通找回來。立即升級您的搜尋架構,見證營收成長的奇蹟!

打破「找不到商品」的轉換率魔咒!2026 實戰 Laravel x 混合向量檢索打造企業級語意搜尋引擎

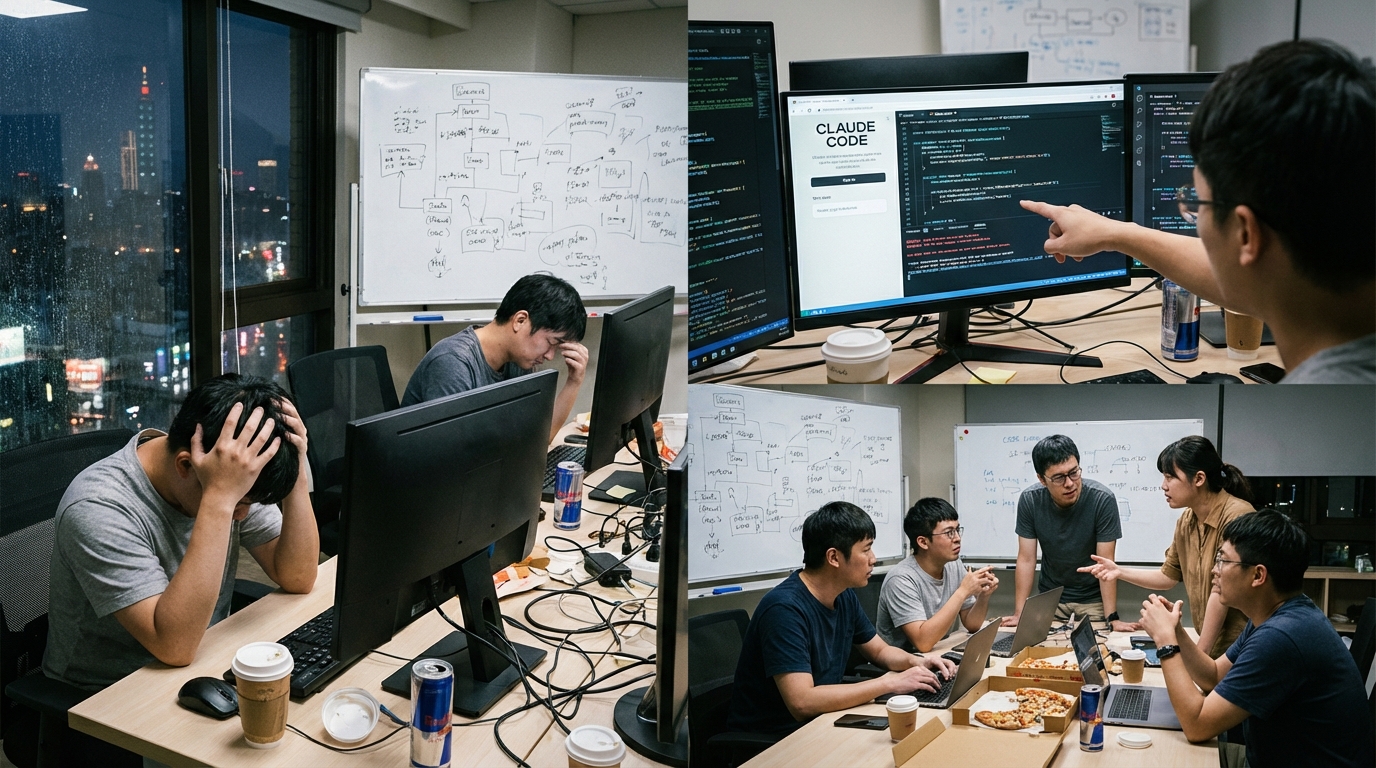

哈囉各位,我是浪花科技的資深工程師 Eric。最近在幫幾間大型電商與 SaaS 企業重構他們的搜尋架構時,真的是聽到客戶抱怨聽到耳朵長繭:「Eric,為什麼使用者搜尋『防風保暖外套』,我們的系統卻連一件『羽絨衣』都找不出來?只是因為商品標題沒有防風兩個字嗎?」

每次聽到這種問題,我就會忍不住在心裡翻個白眼。傳統的關聯式資料庫(RDBMS)像是 MySQL,不管是使用 LIKE '%keyword%' 還是內建的 Full-Text Search,本質上都是在做「字面比對」(Lexical Search)。你用字面去跟機器溝通,它當然只會懂字面,不懂語意。到了 2026 年,如果你的企業級應用還在依賴純關鍵字比對,那無疑是在把高達 40% 的潛在轉換率直接往水裡丟。

既然我們團隊之前已經在《告別「查無此字」的跳出率夢魘》探討過純向量資料庫的基本概念,今天我們就來點更硬核、更符合 2026 年企業實際業務場景的延伸進階玩法:在 Laravel 中實作「混合檢索 (Hybrid Search)」與結合 RAG 架構的終極語意搜尋引擎。

純向量搜尋不夠用?2026 年為什麼我們需要混合檢索 (Hybrid Search)?

很多工程師剛接觸向量資料庫(Vector DB,例如 Pinecone, Qdrant, Milvus)時,都會有一種「發現新大陸」的錯覺,以為把資料通通轉成 Embeddings(向量嵌入),然後做個 Cosine Similarity(餘弦相似度)計算,從此搜尋問題就迎刃而解,世界就和平了。

但現實總是殘酷的,實務上我們常常在除錯日誌裡看到翻車現場。純語意搜尋在處理「精確型意圖」時常常會力不從心。舉個例子:當使用者搜尋「iPhone 16 Pro Max 256GB」,他要的就是這個特定型號的商品,結果你的向量模型覺得「Samsung S26 Ultra」在語意上也是「2026 年的高階手機」,就把它排在搜尋結果前面。這種時候客戶絕對會打電話來罵人,業務端也會氣得跳腳。

- 關鍵字檢索 (Sparse Vector / BM25):擅長精準匹配,對特定型號、人名、專有名詞極度敏銳,確保不會出現指鹿為馬的狀況。

- 向量語意檢索 (Dense Vector):擅長概念與意圖匹配,能理解「防寒」等於「保暖」,「毛小孩」等於「寵物」,解決同義詞字典永遠建不完的痛點。

因此,2026 企業級的標準答案是:混合檢索(Hybrid Search)。透過演算法將兩者的分數進行權重融合(例如業界標準的 Reciprocal Rank Fusion, RRF 機制),這才是真正能落地且高精準的企業級解決方案。

Laravel 結合向量資料庫的核心架構解析

身為 Laravel 的重度開發者,我們最討厭把邏輯全部塞在 Controller 裡面的義大利麵條程式碼。在實作混合搜尋架構時,我們需要明確切分職責。我通常會將整個流程分為三個核心階段:

1. 資料向量化與背景同步機制 (Data Embedding & Synchronization)

這是一個效能地雷區!你絕對不能在使用者寫入資料的當下,同步去呼叫 OpenAI 或其他 Embedding API,那會讓你的 Response Time 悲劇到不行。我們必須利用 Laravel 的 Job 與 Queue 系統進行非同步處理。

namespace App\Jobs;

use Illuminate\Bus\Queueable;

use Illuminate\Contracts\Queue\ShouldQueue;

use Illuminate\Foundation\Bus\Dispatchable;

use Illuminate\Queue\InteractsWithQueue;

use Illuminate\Queue\SerializesModels;

use App\Models\Product;

use Illuminate\Support\Facades\Http;

class SyncProductEmbedding implements ShouldQueue

{

use Dispatchable, InteractsWithQueue, Queueable, SerializesModels;

public function __construct(public Product $product) {}

public function handle()

{

// 1. 組合你要向量化的文本 (提升資料密度)

$text = $this->product->name . ' ' . $this->product->description;

// 2. 呼叫 Embedding 模型轉為向量 (例如 text-embedding-3-small)

$response = Http::withToken(config('services.openai.key'))

->post('https://api.openai.com/v1/embeddings', [

'model' => 'text-embedding-3-small',

'input' => $text,

]);

$vector = $response->json('data.0.embedding');

// 3. 寫入 Vector DB (此處以 Qdrant 虛擬範例為例)

app(VectorDBClient::class)->upsert('products', [

'id' => $this->product->id,

'vector' => $vector,

'payload' => [

'name' => $this->product->name,

'category_id' => $this->product->category_id,

'sku' => $this->product->sku

]

]);

}

}

透過 Eloquent 的 Model Observer,當 Product::saved() 被觸發時,把這個 Job 丟進背景,這樣才能保證主系統的效能不受牽連,同時維持資料的最終一致性 (Eventual Consistency)。

2. 建立混合檢索服務 (Hybrid Search Service)

當使用者輸入查詢時,我們在 Laravel 後端同時進行關鍵字檢索與語意檢索。在 2026 年,許多現代化的 Vector DB 已經原生支援了 Sparse/Dense 混合搜尋,我們只需要透過 API 將使用者的關鍵字轉成 Embedding,同時帶上原始搜尋字串,資料庫就會直接回傳融合後的結果。

3. Metadata 過濾與多租戶權限控制

這是很多新手容易踩坑的資安死角。假設你的系統有「多租戶(Multi-tenant)」設計,你總不能讓 A 公司的員工搜尋到 B 公司的機密文件吧?向量資料庫不只存 Vector,還能存 Payload (Metadata)。在 Laravel 發起查詢時,請務必帶上租戶 ID 或資料權限範圍的 Filter,將語意比對限縮在合法的資料池內。

進階戰術:導入 RAG 架構讓搜尋引擎具備「回答能力」

既然我們已經用 Laravel 把資料都向量化且存入 Vector DB 了,單純回傳「搜尋結果清單」有時候還是無法滿足現代使用者的胃口。現在的企業級系統,更傾向於直接給出精準的答案與總結,這就是 Retrieval-Augmented Generation (RAG,檢索增強生成)。

在你的 Laravel Controller 中,當你從向量資料庫撈出 Top 5 的高相關資料後,你可以把它們的文本萃取出來,當作 Context (上下文) 塞給 LLM 的 Prompt 中,讓模型根據這些專有資料生成精確的摘要回覆。這樣一來,你的系統不僅解決了「查無此字」的跳出率夢魘,更直接進化成了一個專屬的企業 AI 智能顧問,大大提升了使用者體驗與客戶留存率。

推薦延伸閱讀

如果你對 Laravel 的進階架構、效能優化,或是 AI 的深度整合有興趣,強烈建議你閱讀以下我們浪花科技團隊寫過的技術實戰文章,保證能幫你避開許多架構上的坑:

- 告別義大利麵架構!突破傳統 MVC 框架:Agentic Laravel 中的意圖驅動控制器 (Intent-Driven Controllers) 實戰

- AI 聽不懂你的資料庫?Laravel MCP 實戰:2026 年後端工程師必備的 AI 通訊標準

- 拒絕手寫 SQL 地獄!2026 Laravel Eloquent ORM 終極指南:從 N+1 問題到高效能查詢的優雅煉金術

結語:投資現代化搜尋,就是投資轉換率與營收

其實身為工程師,我們都懂維護與重構複雜系統的痛苦。但當你看到原本那些因為打錯字、換句話說而流失掉的潛在訂單,因為導入了 Laravel 與 Vector DB 的混合搜尋引擎而起死回生時,那種看著轉換率圖表往上飆的成就感絕對是無與倫比的。2026 年的技術早已齊備,生態系也非常成熟,剩下的就只是實踐的決心了。

如果你在重構企業搜尋架構、導入 RAG 應用,或是 Laravel 核心系統優化上遇到了瓶頸,別再自己看著伺服器錯誤日誌發愁了。有些技術債,交給有經驗的團隊來拆解會快上好幾倍!

準備好讓你的企業系統脫胎換骨了嗎?

立即前往 https://roamer-tech.com/contact/ 填寫表單聯繫我們,浪花科技的資深技術團隊會為你量身打造最合適、最具擴展性的解決方案!

常見問題 (FAQ)

Q1: Laravel 專案適合串接哪一種向量資料庫 (Vector DB)?

這完全取決於你的基礎設施與資安策略。如果是雲端優先,Pinecone 提供了極佳的 Serverless 方案,不用管底層維運;若是考慮預算成本與地端部署 (On-premise),Qdrant 或 Milvus 是 2026 年極受推崇的開源選擇,它們的 HTTP API 與 Laravel Http Client 的串接都非常直覺流暢。

Q2: 混合檢索 (Hybrid Search) 在效能上會不會比單純的 SQL 查詢慢很多?

必然會多出毫秒級的延遲,因為你需要先呼叫 Embedding API 將關鍵字轉為向量,然後才去查詢 Vector DB。但透過 Laravel 的非同步處理、並行請求 (Concurrency) 以及針對高頻詞句的 Redis 快取層,我們通常能將整體 P95 延遲壓在 100~200ms 以內,對使用者的體驗提升絕對遠超這點效能損耗。

Q3: 如果我的舊系統有幾十萬筆資料,該如何平滑轉移到向量資料庫?

千萬不要傻傻寫個 Foreach 就跑到底!你應該利用 Laravel 的 Chunk 方法搭配 Queue 系統,將這幾十萬筆資料批次分發到背景處理。同時,強烈建議要設定 Rate Limit 中介層,以免不小心把 OpenAI (或其他 Embedding 提供商) 的 API 給打爆,導致系統被鎖並拋出一堆 HTTP 429 錯誤。